글: 자오잉, 월스트리트지언

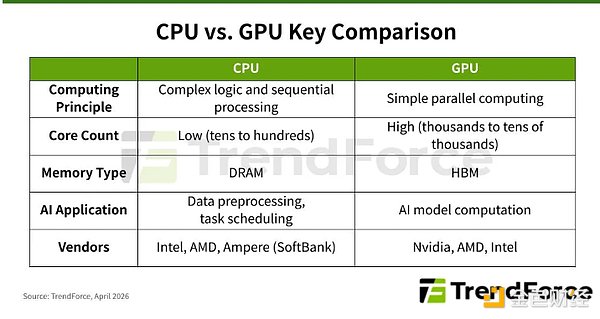

AI 컴퓨팅 성능 경쟁의 초점은 조용히 GPU에서 오랫동안 간과되어 온 CPU로 옮겨가고 있다.

AI 에이전트와 강화 학습(RL) 워크로드의 폭발적인 증가에 따라, 데이터 센터에서 CPU의 전략적 위상은 구조적인 재평가를 겪고 있다. 유명 반도체 분석 기관 SemiAnalysis의 수석 애널리스트 딜런 파텔(Dylan Patel)은 4월 8일 진행된 심층 인터뷰에서, AI 워크로드의 패러다임이 단순한 텍스트 생성을 넘어 복잡한 에이전트와 강화 학습으로 진화함에 따라, CPU는 "극심한 생산 능력 부족"에 직면해 있다고 밝혔다.

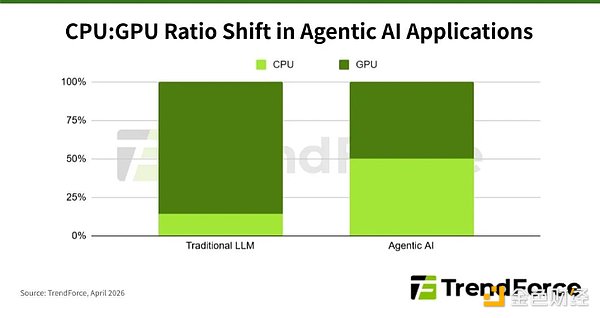

시장 조사 기관 TrendForce의 최신 보고서는 이러한 판단을 뒷받침합니다: 현재 AI 데이터 센터의 CPU와 GPU 비율은 약 1:4에서 1:8 사이이지만, 에이전트 AI 시대에는 이 비율이 1:1에서 1:2로 크게 좁혀질 것으로 예상됩니다.

이러한 구조적 변화는 이미 수급 양측에서 연쇄 반응을 일으키고 있다. 인텔과 AMD는 2026년 1분기 말에 일부 CPU 제품군의 가격을 인상했다. 이와 동시에 엔비디아와 ARM은 2026년 3월 서버 CPU 시장 진출을 발표했습니다. 한 GPU 거대 기업과 한 IP 라이선스 업체가 같은 달에 동일한 선택을 한 것은 결코 우연이 아니라, 시장 신호의 집중적인 발신입니다.

지능형 시스템의 부상, CPU는 조연에서 병목으로

AI 발전의 초기 단계에서 CPU의 역할은 상당히 주변적이었다. 딜런 파텔(Dylan Patel)은 이를 다음과 같이 묘사했다. "부하가 매우 적었다. 문자열 하나를 보내면 문자열 하나를 돌려주는 식의 단순한 추론이었기에 CPU에 대한 요구가 크지 않았다. "당시 GPU는 대규모 병렬 행렬 연산 능력을 바탕으로 AI 연산 수요를 주도했고, CPU는 GPU로 메모리 데이터를 압축하고 라우팅하는 보조 기능만을 담당했다.

그러나 OpenAI o1을 대표하는 차세대 추론 모델과 이에 따라 부상한 AI 에이전트 아키텍처는 이러한 구도를 근본적으로 바꿨다. 정적인 대규모 언어 모델과 달리, 에이전트 AI는 환경과 동적으로 상호작용해야 합니다. 즉, 작업을 계획하고, 도구를 호출하며, 하위 에이전트 간에 데이터를 전달하고, 작업 완료 여부를 평가해야 합니다. 이러한 '오케스트레이션(Orchestration)' 계층의 모든 조정 작업은 바로 CPU의 몫이며, 이로 인해 CPU 집약적인 부하가 됩니다.

2025년 11월에 발표된 학술 논문 《A CPU-Centric Perspective on Agentic AI》는 이러한 부담을 더욱 정량화했다. 에이전트 AI 시나리오에서 CPU 도구 처리(Python 해석, 웹 크롤링, 어휘 요약, 데이터베이스 검색 등 포함)로 인한 지연은 전체 지연의 최대 90.6%를 차지할 수 있다; 대량 처리 시나리오에서는 CPU의 동적 전력 소비가 시스템 전체 동적 전력 소비의 44%에 달할 수 있습니다.

Arm의 추산치는 용량 측면에서 수요 격차의 규모를 드러냅니다: 기존 AI 데이터센터는 기가와트(GW)당 약 3,000만 개의 CPU 코어가 필요하지만, 에이전트 AI 시대에는 이 수요가 1억 2,000만 개로 급증할 것으로 예상되며, 이는 4배에 달하는 증가율입니다.

인텔은 압박을 받고, AMD는 기세를 몰아 확장

CPU 수요의 구조적 증가는 우선 전통적인 x86 시장에서 판도 재편을 촉발했다.

인텔의 제온(Xeon) 프로세서는 오랫동안 데이터센터 CPU 시장의 95% 이상을 점유해 왔다. 이러한 지배적 지위는 2021년부터 흔들리기 시작했다. 인텔 7 공정 수율 문제로 인해 제온 사파이어 래피즈(Xeon Sapphire Rapids)의 출시가 2년 가까이 지연되면서, AMD의 EPYC 밀란(EPYC Milan)에게 시장 진입의 틈을 열어주었다.

2026년, 인텔은 두 가지 플래그십 제품을 출시할 계획이다: Darkmont 아키텍처를 채택한 제온 6+(Clearwater Forest)는 288코어/288스레드를 갖추고, TDP 약 450W; 그리고 Panther Cove-X 아키텍처를 채택한 제온 7(Diamond Rapids)으로, 최대 256코어/256스레드, TDP는 650W에 달한다. 두 제품 모두 인텔의 최첨단 18A 공정을 기반으로 하며, 최초로 Foveros Direct 하이브리드 본딩 기술을 도입합니다. 그러나 TrendForce는 18A 공정의 수율 문제가 지속되면서 두 제품의 양산 시기가 2027년으로 연기될 가능성이 있다고 지적했습니다.

이에 비해 AMD의 행보는 더욱 안정적입니다. 2026년 플래그십 제품인 EPYC Venice는 TSMC의 N2 공정과 Zen 6 아키텍처를 채택하고, CoWoS-L 및 SoIC 첨단 패키징을 탑재하여 SMT(동시 멀티스레딩) 기술을 통해 256코어/512스레드를 구현할 예정이며, 이는 현재 시장에서 가장 많은 스레드 수다.트렌드포스는 AMD가 2026년에도 인텔로부터 시장 점유율을 지속적으로 잠식할 것으로 전망했다.

엔비디아, Arm의 강력한 진입으로 경쟁 구도 재편

전통적인 x86 양대 산맥 외에도, 비전통적인 플레이어들이 전례 없는 속도로 서버 CPU 시장에 진입하며 경쟁 구도를 근본적으로 바꾸고 있다.

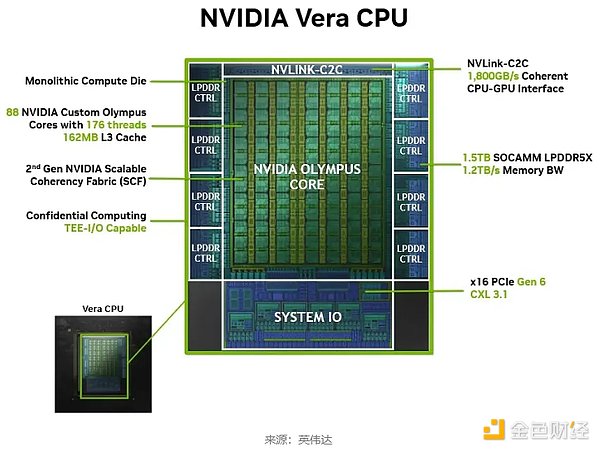

2026년 3월, 엔비디아는 고객의 보다 유연한 CPU:GPU 구성에 대한 수요를 충족시키기 위해 Vera CPU를 독립형 제품으로 출시하겠다고 발표했다. Vera는 엔비디아가 자체 개발한 Olympus 아키텍처를 채택하고, TSMC의 N3 공정과 CoWoS-R 패키징을 기반으로 하며, 88코어/176스레드를 제공하고 1.8 TB/s의 NVLink-C2C 인터커넥트를 탑재해 엔비디아 GPU와 메모리 공유가 가능합니다. 첫 번째 파트너사로는 알리바바, 바이트댄스, 클라우드플레어, 코어위브, 오라클 등이 포함됩니다. 엔비디아는 또한 베라 CPU 랙을 출시했는데, 단일 랙에 256개의 CPU가 통합되어 총 22,528코어/45,056스레드를 제공하며, 총 메모리는 400TB에 달합니다.

같은 달, Arm은 첫 자체 개발 CPU 제품인 Arm AGI CPU를 출시한다고 발표하며, 35년간의 순수 라이선스 공급업체로서의 역사적 위치를 마감했다. 이 제품은 TSMC의 N3 공정과 Neoverse V3 아키텍처를 기반으로 하며, 136코어/136스레드를 제공하며, TDP는 300W이고, DDR5-8800 메모리와 PCIe Gen6를 지원한다. 첫 번째 파트너사로는 메타(Meta), 오픈AI(OpenAI), 세레브라스(Cerebras), 클라우드플레어(Cloudflare), SK텔레콤 등이 포함된다. Arm은 동시에 두 가지 랙 구성을 출시했다. 공랭식 모델은 60개의 AGI CPU(8,160코어, 약 180TB 메모리)를 통합하고, 수랭식 모델은 336개의 CPU(45,696코어, 1PB 메모리)를 지원한다.

주요 클라우드 서비스 제공업체(CSP)들도 자체 개발 CPU 구축을 가속화하고 있다. AWS는 2025년 12월 TSMC의 N3 공정을 기반으로 한 Graviton5(192코어/192스레드)를 출시하고, 자체 개발한 Trainium 3 AI ASIC과 함께 배포하여 AI 컴퓨팅 비용을 절감할 계획이다; 마이크로소프트는 2025년 11월 코발트 200(Cobalt 200, N3 공정, 132코어/132스레드)을 출시할 예정이며; 구글은 2026년에 최고 가성비를 내세운 액시온 C4A.metal 베어메탈 버전 및 차세대 액시온 N4A를 출시할 계획이다.

IC 후단 설계 서비스 업체에 새로운 성장 기회 도래

비전통적 업체들의 대규모 진입은 IC 후단 설계 서비스 업체들에게 상당한 신규 사업 기회를 창출하고 있다.

TrendForce는 AWS가 현재 여전히 CPU 후단 설계를 자체적으로 수행하고 있는 반면, 구글과 마이크로소프트는 이미 CPU 후단 설계 서비스를 글로벌 유니칩(Global Unichip Corp., GUC)에 아웃소싱하고 있다고 지적했다. 더 많은 CSP와 신흥 CPU 제조사들이 시장에 진입함에 따라 이러한 아웃소싱 수요는 지속적으로 확대될 전망이다.

TrendForce는 2026년부터 2028년 사이에 브로드컴(Broadcom), 마벨(Marvell), GUC, 알칩(Alchip), 미디어텍(MediaTek) 등 ASIC 설계 서비스 업체들이 상기 고객사들로부터 신규 프로젝트를 잇달아 수주할 것으로 전망했다. AI 인프라 투자에 대한 새로운 진입점을 모색하는 시장 참여자들에게 있어, 이 분야는 GPU 열풍을 제외하면 아직 충분히 반영되지 않은 구조적 기회일 수 있다.

Anais

Anais

Anais

Anais Catherine

Catherine Weatherly

Weatherly Catherine

Catherine Weatherly

Weatherly Kikyo

Kikyo Catherine

Catherine Anais

Anais Kikyo

Kikyo Weatherly

Weatherly