著者:シャオジン、テンセント・テクノロジー

計算能力トークンはAI時代の価値の座標を再構築しつつあるが、その透明性こそが、価値はブラックボックスAI業界は、結果に真に価格を付けられる基準を依然として模索している。

去る3月、ジェンスン・ホアンはGTC 2026のステージに立ち、トークンが牽引する新たな産業時代を描き出した。AIファクトリーが絶えずトークンを生み出し、エージェント型AIが推論需要を新たなピークへと押し上げる。その話ぶりからすると、トークンはAI時代において最も標準的で、統一され、定量化可能な経済単位のように思える。

大規模モデルの公式価格ページを開くと、そこにも産業標準に近いほど整然とした統一性が見て取れる。100万トークンごとの価格が明示され、入力、出力、キャッシュ、バッチ処理ごとに明確な価格帯が設定されている。こうした形式上の高度な均一性は、しばしば人々に錯覚を抱かせる。すなわち、AI業界はすでにルールが成熟し、製品が標準化された競争段階に入り、トークンこそがこの時代で最も重要な尺度であるかのように。

しかし、事実は正反対だ。

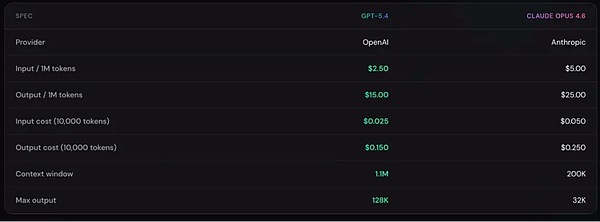

2026年4月、OpenAIのフラッグシップモデルであるGPT-5.4の入力価格は100万トークンあたり2.5ドル、出力は15ドルであったのに対し、AnthropicのフラッグシップモデルであるClaude Opus 4.6は5ドルと25ドルだった。価格だけを見れば、Anthropicの方が2倍高い。しかし、企業の技術責任者にとって、単にこの2つの数字を比較することには何の意味もない。両社のコンテキストウィンドウ戦略、ツール呼び出しの課金ロジック、キャッシュ割引の深度における差異は、価格上の倍率関係を相殺し、さらには逆転させるのに十分である。

トークンの価格は確かに透明ですが、その背後にある「価値」はブラックボックスです。同等の価値を得るために、一体どれだけの価格を支払う必要があるのか、現時点では明確に定義することは困難です。

一、同じトークンでも、知恵は異なる

トークンの価格設定自体は、決して神秘的なものではない。

API(アプリケーション・プログラミング・インターフェース)を長年使用しているある開発者は、「トークンの価格はブラックボックスではなく、ベンダーも偽造することはできない。入出力されるトークンの数量は推定可能であり、たとえトークナイザーが公開されていなくても、ほぼ算出できる」と述べている。

図:GPT-5.4とOpus 4.6の価格比較

経済学的に言えば、これは典型的な「均質化された計量単位」に似ています。電力におけるキロワット時やストレージにおけるGBのように、トークンは標準化された消費量の尺度を提供し、売り手と買い手が同じ尺度で取引できるようにします。

しかし問題は、トークンが単なる従来の計量単位ではなく、知能を計量し、ある種の価値を約束している点にある。ユーザーがトークンを購入するのは、モデルの「知能」を獲得し、真の生産力として活用するためだ。例えば、動作するコードを記述したり、カスタマーサポートの対話を完了させたり、データ分析を行ったりすることである。そして、この「1トークンでどれだけの能力が得られるか」という交換レートこそが、真のブラックボックスなのである。

また、開発者からは「例えば新しいモデルがリリースされる前など、モデルベンダーがAIの知能レベルや思考強度を下げることがある。これはブラックボックスだが、ユーザーには感じ取れる」というフィードバックもある。

2026年4月初旬、AMDのAI戦略ディレクターであるStella Laurenzo氏は、6852件のClaude Codeセッションに基づく分析結果をGitHubで公開した。データによると、2026年2月下旬から、Claude Opus 4.6の推論深度が大幅に低下した。「reads-per-edit」(コードを編集する前のファイル読み取り回数)は6.6から2.0へと急落し、約67%の減少となった。言い換えれば、モデルはもはやコードを注意深く読み込むことなく、すぐに修正に取り掛かるようになったのである。

Laurenzo氏の結論は次の通りだ。「思考が浅くなると、モデルはコストが最も低い行動を取る傾向がある。読み込まずに直接修正したり、未完成のまま停止したり、誤りを他者のせいにしたり、最も正しい解決策ではなく最も簡単な解決策を選んだりすることだ。」

4月14日、メディアは公開報道の中でこの件のもう一つの側面を伝えた。Claude Codeの創設者であるBoris Cherny氏は、2月9日からOpus 4.6で「adaptive thinking」(適応的思考)がデフォルトで有効化され、3月3日にはデフォルトのeffort level(努力レベル)が「高」から「中」(85%)に調整されたと回答した。Anthropic社は、これを「大多数のユーザーにとって、知能、遅延、コストの間の最適なバランス」であると考えている。ユーザーは手動で/effort highと入力することで、完全な推論を復元することができる。

問題は、これらの変更がユーザーに対して目立つ場所で通知されていなかった点にある。多くの開発者は、コードの品質が明らかに低下してから初めて、「モデルが鈍くなったのではないか」と疑い始めた。しかし、これを証明するのは困難であり、「テスト環境が一致していない」という一言で疑問に完璧に答えることができる。「大規模モデルの確率的な性質により、一部の事象を決定的に立証するのは難しい。」

これこそが、トークン経済学において最も重要であり、かつ価格設定が最も難しい変数である。同じ100万トークンを消費しても、得られる推論の品質は全く異なる可能性がある。ピーク時とオフピーク時では異なり、デフォルト設定と手動でeffortを上げた後では異なり、サブスクリプションユーザーがクォータ上限に近づいた時とクォータに余裕がある時でも異なる可能性がある。トークンの数量と価格は透明だが、トークンにどれだけの「知能」が詰め込まれているかは、ユーザーには知る由もなく、事前に取り決めることもできない。

経済学には「ヘドニック調整(hedonic adjustment)」という概念がある。ある商品の質が変化した場合、名目価格は変わらなくても、実質価格はすでに変化しているということだ。

トークンは現在、このようなジレンマに直面している。表示価格は変わらず、数量も変わらないが、「実質価値」が密かに低下している可能性があるのだ。これは価格上昇よりも隠蔽されやすく、責任の追及も困難である。

二、価格を左右する「キャッシュヒット率」

「知的能力」の変動というブラックボックスに加え、価格表の下にはさらに隠れたコスト構造が存在する。

2026年2月、Claude Codeのアップデートにより、サードパーティ製プラットフォームのキャッシュヒット率が大幅に低下した。直後に、Anthropicが意図的にサードパーティ製モデルのキャッシュを破壊したのではないかという疑念が浮上した。

あるエンジニアがAIツールを使用して、Claude Code v2.1.0からv2.1.41までの計11バージョンのソースコードをダウンロードし、一つずつ分析した。結論として、コード内にはサードパーティ製モデルを意図的に破壊するロジックは存在しなかった。しかし、v2.1.23以降、Claude CodeにはClaude専用のチャンクキャッシュメカニズムが導入された。「セッションを跨いだグローバル共有、有効期限1時間」といった最適化により、システムプロンプトの構造が変更された。サードパーティ製モデルのAPIはこれらのマーカーを識別できず、最も基本的なプレフィックス一致に依存するしかなかったが、そのプレフィックスはバージョン番号、ビルド日時、A/Bテスト変数の絶え間ない変化により、極めて不安定であった。

平易な言葉で要約すると、Anthropicは意図的に「毒を盛った」わけではないが、自社モデルの効率を最適化する過程で、副作用として、サードパーティ製モデルが本来依存していたキャッシュ条件を破壊してしまった。

これは意図的な行為ではないが、ある事実を浮き彫りにしている。すなわち、キャッシュのヒット率が、トークンにいくら支払うかを決定するという点だ。ある開発者がClaude Codeの1週間分の使用データを追跡したところ、通常はトークンの91%がキャッシュヒットによるものであり、キャッシュヒットの価格は標準入力価格のわずか10分の1であることが判明した。もしキャッシュがすべて失効した場合、入力コストは元の5.7倍に急騰する。

Claude Codeの創設者であるBoris Cherny氏自身も次のように認めています。「1Mのコンテキストウィンドウを使用する場合、キャッシュミスによるコストは非常に高くなります。1時間以上コンピュータから離れてから以前のセッションを再開すると、通常はキャッシュが完全にヒットしなくなります。」

さらに注目すべき詳細がある。コミュニティでは、Claude Codeがユーザーが「Extra Usage」(超過課金)モードに入ったことを検知すると、キャッシュの有効期間を1時間から5分に黙って短縮するという分析が広まっている。つまり、5分以上操作を中断するだけで完全なコンテキストの再構築がトリガーされ、費用は超過残高から直接差し引かれることになる。

メディアの報道によると、4月にProユーザーから、5時間以内にClaude Codeでプロンプトを2回しか送信できないという報告がありました。あるユーザーはこう述べています。「これらのキャッシュのバグが修正されるまでは、5分か1時間のTTLに関する議論はすべて空論です。なぜなら、その数値自体が完全に間違っているからです。」

キャッシュヒット率の例からも分かるように、同じ結果(価値)を得たとしても、支払う価格には大きな変動が生じます。

三、300倍の価格下落の背後にある予算の泥沼

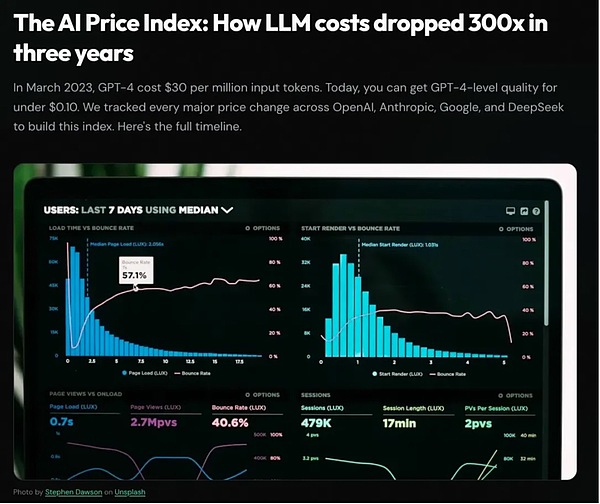

業界データによると、トークンの単価は3年間でおよそ300倍下落したが、企業のAI支出はかえって管理しづらくなっている。その理由は単純だ。単価の下落幅が、利用量の急増に追いついていないからだ。

図:3年間でLLMのトークン単価は約300分の1に下落——しかし、単価の暴落によって企業のAI支出が予測しやすくなったわけではない。(出典:TokenCost)

エージェント型アプリケーションは、AIに複雑で長い処理チェーンのタスクを自律的に実行させるもので、1回の処理で消費するトークン数は従来の対話型AIの数十倍に達する可能性がある。アジア太平洋地域のEコマース技術企業Branch8の6人チームは、Claude Codeを導入した最初の1ヶ月で2,400ドルを費やした。その後、1日あたりのトークン割り当ての設定、思考モードの予算制限、非重要タスクのOpusからSonnetへの切り替えなど、8週間にわたる集中的な最適化を経て、ようやく680ドルまで抑えることができた。トークン支出の管理自体が、すでに専門的なスキルを要する業務となっている。

Nutanixの2026年.NEXTカンファレンスで、あるCIOがさらに極端な事例を共有した。ある開発者が10万ドルもの予期せぬトークン請求を生み出し、全く準備ができていなかったCFOに説明せざるを得なかったという。彼自身の言葉を借りれば、それは「極めて気まずい会議」だった。別の参加者は、すでに従業員に「配給制のように」毎日のトークン割り当てを行っている企業があると語った。

MavvrikとBenchmarkitによる372社の調査は、この普遍性を裏付けている。84%の企業が、AIコストによる粗利益率への影響が予想を上回っていると報告しており、予算の誤差を10%以内に抑えられているのはわずか15%に過ぎない。

経済学的に言えば、これは「単位の失敗」の典型的な現れだ。ある測定単位が、キャッシュや知能の低下といった隠れた変数といったコストを正確に反映できず、かつ価値も正確に反映できない場合、同じトークンでも異なるシナリオ下で生み出す成果が天と地ほど異なることになる。そうなれば、その単位は測定の基本的な機能を失い、市場がコンセンサスを形成したり、取引の摩擦を低減したりする助けにはならない。

別の角度から見れば、Tokenの消費量の急増は、モデル企業にとって依然として核心的なストーリーである。

しかし、Tokenの増加は同時にコストの問題でもある。OpenAIの2025年の推論コストは84億ドルに達し、2026年には141億ドルに上昇すると予想され、年間の現金消費は約170億ドルとなる見込みだ。同社はすでに5000億ドルを超えるクラウドインフラ契約を締結している。Anthropicの累計資金調達額は640億ドルを超えている。両社とも現時点では黒字化していない。

OpenAIは2026年4月、企業価値8520億ドルで1220億ドルを調達し、Anthropicは2月、企業価値3800億ドルで300億ドルを調達した。投資家は、将来的に1トークンあたりの計算リソースコストが継続的に低下し、「トークンの販売」が最終的に利益を生むビジネスになることを期待している。

しかし、初期のAmazonが販売していたのは標準化された商品やクラウドサービスであり、単位経済モデルは比較的安定していた。AI企業が販売しているのはトークンであり、一見標準化されているように見えても実際には高度に異質なものであり、その異質な部分(知的要素、キャッシュ効率、タスクへの適合度)こそが、コストと価値に影響を与える核心的な変数である。「スケールメリット」が予定通り現れるかどうかは、ECやクラウドコンピューティングの時代よりも不確実性が高い。

四、業界は価格設定の「アンカー」を探している

核心的な問題に戻ろう:誰がTokenの価値を正確に算出できるのか?

短期的には、誰もできない。トークンの価格は透明だが、それによって交換される知性の質は変動し、その背後にある真のコストはキャッシュ、フレームワーク設計、計算効率によって幾重にも折り重なり、そこから生み出されるビジネス価値はシナリオによって異なる。

一つの計量単位がこれほど多くの次元の不確実性を同時に抱えていること自体が、それがまだAI時代の尺度にはなり得ないことを示している。

トークンもまた、標準的な価格設定が可能な商品にはなっていない。それは、AI業界が価値の「アンカー」を見つけるまでの間、誰もが使用せざるを得ない暫定的な会計単位に過ぎない。

現在、業界におけるトークンの価格設定は、本質的には依然として「計算能力の使用権」に対する価格設定であり、購入しているのはモデルに一度「思考」させる機会である。その思考がどれほど深く、どれほど優れているか、最終的に問題が解決されるかどうかは、この価格の約束の範囲外にある。

この価格設定方式の合理性について、現時点ではどの当事者も単独で判断することはできない。ベンダーはユーザーに代わって出力されたビジネス価値を測定できず、ユーザーはモデルの推論プロセスを透視して各トークンが「コストに見合う価値がある」かどうかを判断できず、投資家は消費量の増加曲線は見ていても、各トークンの価値転換率は見えていない。

最終的にトークンの価値を正確に算出できるのは、おそらく、顧客が喜んで対価を支払う「成果単位」を見出し、スマートな真の生産力を定義し、内部でトークンコストと計算リソースコストの換算関係を予測可能なレベルまで管理できる者だろう。

Davin

Davin

Davin

Davin Brian

Brian Alex

Alex Kikyo

Kikyo Brian

Brian Brian

Brian Joy

Joy Alex

Alex Kikyo

Kikyo Brian

Brian